“Que há num simples nome? Aquilo que chamamos de rosa, com outro nome, teria igual perfume.”. É inevitável a lembrança do verso de Romeu e Julieta ao observar a decepção coletiva quando do lançamento da mais recente versão do telefone da Apple, chamado então iPhone 4S.

A falta de inovações estéticas, atrelada a um nome que veio contra o esperado por grande parte das pessoas (que pré-aclamaram o “iPhone 5”) trouxe frustração a uma série de Macmaníacos (ou nem tanto), que execraram o novo produto.

Em meio as citadas “mais de 200 novas funcionalidades”, uma em especial perdeu um pouco de seu brilho em meio à sombra gerada por um nome e um design ditos ultrapassados. O reconhecimento vocal do SIRI, contudo, é de fato uma evolução tecnológica trazida às massas que implicará em mudanças consideráveis na maneira como interagimos com as máquinas.

O que o SIRI faz? Nada mais que uma combinação entre reconhecimento vocal e sua combinaçao para disparar comandos e funcionalidades a partir de termos chave. No fundo, a tecnologia em si não é nova; a IBM vem trabalhando em sistemas de reconhecimento de voz desde os anos 80, com seu ViaVoice, que foi liberado publicamente para desenvolvedores em 2004; o Google também investe consideravelmente no desenvolvimento de sistemas de voz para aplicações mobile. O próprio software por trás do SIRI foi resultado da compra da empresa homônima, pela Apple, em abril de 2010.

O que o iPhone 4S faz, assim como seus antecessores, é tornar uma nova tecnologia massificada e economicamente viável, sendo antes restrita aos geeks e early-adopters de plantão. Com isso, ela gera as rupturas no mercado que fazem com que todos os concorrentes da empresa da maçã dêem um salto tecnológico para não perderem mercado – hoje em dia, por exemplo, é difícil imaginar um smartphone ou tablet sem tecnologia touch.

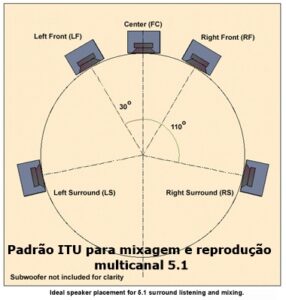

Observando a evolução dos dispositivos, nota-se que a Apple comandou, até agora, duas das quatro ondas que determinam como é feita a interação entre humanos e computadores.

Revivendo um pouco as aulas de história, no início do século 18 a revolução industrial, entre outras coisas, mecanizou a relação do homem e seus meios de produção (de produtos, de informação). A relação mecânica se viu refletida então na maneira como a tecnologia da informação era feita, desde os cálculos de estratégias de guerra do ENIAC, em 1946, passando pelos cartões perfurados, pelos rolos magnéticos, e chegando aos desktops de hoje, onde o input de dados, ou melhor, a solicitação de comandos, ainda é feita de maneira, entre aspas, mecânica (com um teclado e mouse), embora o output tenha evoluído de fitas uma grande tela chamada monitor – Isso sempre me lembra do problema moderno enfrentado por Jane Jetson, a dedicada dona-de-casa do desenho animado, que sofria de tendinite ao ter que apertar tantos botões para cozinhar.

A lógica de “apertar botões”, tendo uma resposta digital a um estímulo mecânico, é a dominante até hoje.

A segunda onda começa a trazer elementos físicos para a CMC (Comunicação Mediante Computador), quando introduz a relação de toque com o significante. Os elementos de interação (imagem, arquivos) deixam de ser comandados por botões, bem como deixam de ser uma projeção em uma tela, para ser gerenciado pelo toque. Não se usa mais um elemento externo (seta do mouse) para acessar o que se deseja (programa, ícone), você toca naquilo que quer.

Lembrando 2005, o que efetivamente surpreendeu as pessoas no lançamento da primeira geração do iPhone foi justamente disponibilizar a qualquer um, por módicos US$ 499, uma nova maneira de se relacionar com seu computador simplesmente tocando naquilo que você queria. A isto seguiram-se desktops, controles remoto, popularização dos tablets, tudo comandado através do toque, no melhor estilo Minority Report.

A humanização da interação homem-máquina segue presente na terceira onda, a utilização de elementos biométricos para o input dos dados.

Embora, claro, a questão do toque, na segunda onda, também possa ser considerado biométrico, ele ainda demanda a utilização de dois sentidos (combinação entre visão e tato) para execução da tarefa – o tato, de maneira isolada e independente, não inicia a ação.

Da mesma maneira, comandos por voz existem em praticamente todos os telefones lançados de um ano para cá. A diferença está novamente na massificação, ou aplicação da funcionalidade em escala. No SIRI, a voz não é aplicada unicamente como um comando, havendo, na verdade, uma interpretação de palavras-chave que possam então acionar alguma funcionalidade.

Pode-se argumentar que, novamente, o reconhecimento de voz em si e sua interpretação de maneira a criar quase que um diálogo entre usuário e máquina não são novidades – Para os mais saudosistas lembrarem das interações com o bot SeteZoom, da Colgate. O que a Jobs’ company fez, outra vez, foi tornar esta funcionalidade acessível às massas, e não mais restrita a ações pontuais de marketing ou relacionamento, nem algo que todos já ouviram falar mas poucos efetivamente experimentaram.

A incorporação do comando de voz para múltiplas atividades do iPhone não somente servirá para marcar seus compromissos em sua agenda mas, como todas as inovações em massa implementadas pela Apple, servirem como fagulha criativa para outros fabricantes, de celulares, de eletroportáteis, de automóveis; não me surpreenderia, portanto, de poder, em pouco tempo, entrar em meu carro dizendo: “Quero ir para o escritório”, meu GPS traçar o caminho orientando-me que estou quase sem combustível e o posto de confiança com preço mais baixo fica logo em frente (não em um carro de R$ 800.000,00, mas em qualquer R$ 30.000,00 de concessionária).

Ao acordar, “espelho, espelho meu, que reuniões terei hoje?”, e seu calendário ser exibido (não em uma mansão, mas em qualquer financiamento da Caixa Econômica). A inovação da Apple não está em uma nova tecnologia, mas sim em disponibilizá-la a um preço acessível (por favor, descontar os impostos brasileiros ao interpretar o termo “acessível”).

A quarta onda está em desenvolvimento, com diferentes pesquisas que permitirão unir a requisição a um dispositivo qualquer à mais pura forma de desejo, o pensamento.

Diversos experimentos têm sido feitos em interpretar ondas elétricas cerebrais como indicação de comando, sobretudo no campo da biônica (Wikipedia: ciência que estuda determinados processos biológicos dos seres vivos (mecanismos mecânicos e eletrônicos) a fim de aplicar processos análogos à técnica e à indústria (implantes artificiais ou a sistemas industriais).

Se considerarmos que pensamentos nada mais são do que ondas elétricas induzidas de determinada maneira, ao mapear estas ondas seria possível interpretar o que se deseja e, com isto, responder à solicitação. Este campo traz múltiplos desafios para os profissionais do ramo, entre eles a necessidade de concentração contínua do cérebro na execução de uma tarefa de média/-longa duração (como movimentar uma cadeira de rodas por alguns metros), o que bloquearia o cérebro para outras funções cognitivas, necessitando exercitar o cérebro para manter uma atenção dividida.

Quando tratamos de comandos pontuais, relacionados a uma necessidade momentânea como “feche o vidro do carro” ou “ligue para Fulano”, a atenção seletiva é feita de maneira quase instantânea, o que permitira isolar o comando a um dispositivo de pensamentos corriqueiros individuais ou durante a interação com outros seres humanos.

Resta saber se o iPhone 8 vai ler minha mente. [Webinsider]

…………………………

Conheça os serviços de conteúdo da Rock Content..

Acompanhe o Webinsider no Twitter.

JC Rodrigues

JC Rodrigues (@jcrodrigues) é publicitário pela ESPM, pós-graduado pela UFRJ, MBA pela ESPM. Foi professor da ESPM, da Miami Ad School e diretor da Disney Interactive, na The Walt Disney Company.

2 respostas

Tudo isto parece ser muito interessante. Digo isto porque esta tecnologia se restringe, ou melhor dizendo, está restrita pelas condições econômicas de cada indivíduo.Será que alguém já fez as contas de quantas pessoas no mundo tem acesso a estas tecnologias? Pode ser que para alguns, e eu me incluo neste grupo, ter um comando de voz é algo surpreendente. Então este ideal da Aplle de levar às massas estas tecnologias, ainda que por interesses econômicos. Ou seriam por motivos humanistas?

Eu já me daria por contente se eu tivesse acesso a uma tecnologia na qual eu pudesse falar e o computador registrar em um documento de word. Depois era só estruturar o texto e fazer algumas correções, e pronto!

De que adianta alguém estar na frente? Se por companhia tiver somente a solidão. Melhor, então, diminuir o passo e ter a seu lado mais pessoas com que pudesse compartilhar a alegria da vitória.

Digo isto até para que se entenda que a tecnologia tem a sua importância. Mas, não nos esqueçamos, que se ela não tiver como prioridade o ser humano, ela perderá seu valor.

Fantastico! Obrigada por partilhar este conhecimento todo conosco!