Precisão em LLMs: esses modelos são capazes de gerar textos, códigos e análises impressionantes, mas operam como ferramentas probabilísticas, não como entidades confiáveis.

Já estamos usando LLMs há alguns anos e creio que podemos ser bem mais racionais, deixando de lado o entusiasmo juvenil. É verdade que os LLMs (Large Language Model), através de bots como o chatGPT revolucionaram a forma como interagimos com a tecnologia, oferecendo funcionalidades que há pouco eram consideradas ficção científica.

No entanto, sua adoção em contextos profissionais exige um entendimento claro de suas limitações, especialmente quando projetos dependem de prazos, custos e resultados previsíveis.

Apesar dos avanços, os LLMs não atingiram, e provavelmente não atingirão, um nível de autonomia que permita substituir a expertise humana em tarefas críticas. Esses modelos são capazes de gerar textos, códigos e análises impressionantes, mas operam como ferramentas probabilísticas, não como entidades confiáveis. A aleatoriedade inerente a seu funcionamento significa que, para uma mesma entrada, podem produzir desde uma solução brilhante até um erro grave, sem aviso prévio.

Isso os torna inadequados para cenários onde a precisão não é negociável, como diagnósticos médicos, contratos legais ou desenvolvimento de sistemas de segurança. Um engenheiro de software, por exemplo, pode usar um LLM para prototipar código, mas depender exclusivamente dele seria equivalente a confiar a construção de um arranha-céu a um assistente que mistura projetos arquitetônicos com poesias haicai.

Ferramentas convencionais possuem comportamentos previsíveis. Uma serra elétrica corta madeira, um software de planilhas calcula fórmulas. Já os LLMs desafiam essa lógica. Sua capacidade de “entender” comandos é limitada por treinamento em dados históricos e falta de consciência contextual.

Para empresas, essa imprevisibilidade gera riscos operacionais. Como estimar prazos ou custos se um modelo resolve complexas equações diferenciais em segundos, mas falha em prompts simples?

Isso não reduz o valor desses modelos, mas define sua área de atuação. Eles são mais eficazes como aceleradores de produtividade em tarefas onde a variação é bem-vinda, como geração de ideias, redação de e-mails ou prototipagem rápida.

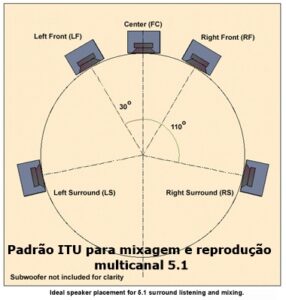

Os LLMs podem e devem ser usados como assistentes, mas com outputs sempre validados, ajustados e contextualizados por humanos. Assim, para que as empresas aproveitem os LLMs sem comprometer sua operação, é essencial definir limites claros para seu uso, treinar os funcionários, não apenas para usar as ferramentas, mas para identificar vieses, inconsistências e falhas lógicas, e adotar práticas de transparência com clientes sobre o papel da IA nos processos.

A discussão sobre LLMs não deve ser “humanos versus máquinas”, mas como integrá-los de forma ética e estratégica. A verdadeira revolução não está na autonomia das máquinas, mas na nossa habilidade de transformar suas potencialidades em ferramentas úteis. Que só nós, seres humanos podemos fazer. [Webinsider]

. . .

Mais Taurion:

Ferramentas LLM: produtividade sim, criatividade mais ou menos

O paradigma “quanto maior, melhor” na inteligência artificial