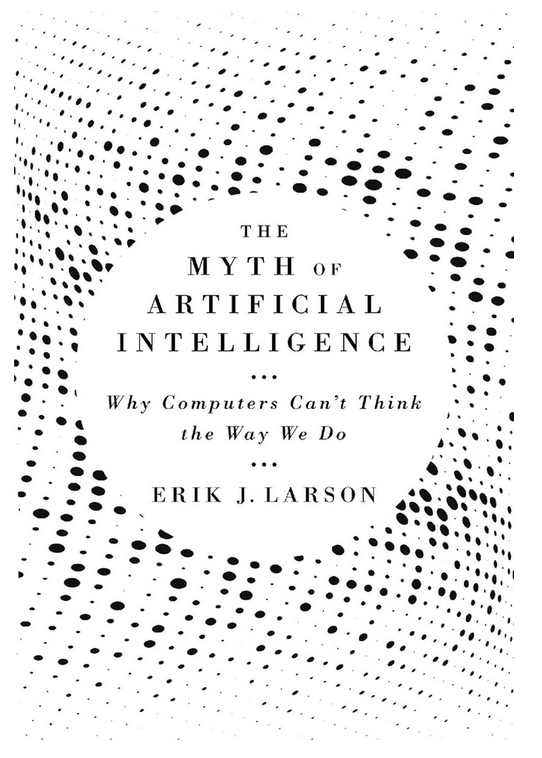

O mito da inteligência artificial é uma falácia. Criar uma superinteligência não é apenas questão de tempo. Não sabemos como fazer.

O mito que ele aponta é que a chegada de um software que alcance a inteligência humana, não apenas em “narrow tasks”, mas de forma abrangente, ou seja, uma superinteligência, que pelo hype atual parece ser inevitável e apenas questão de tempo, é uma falácia.

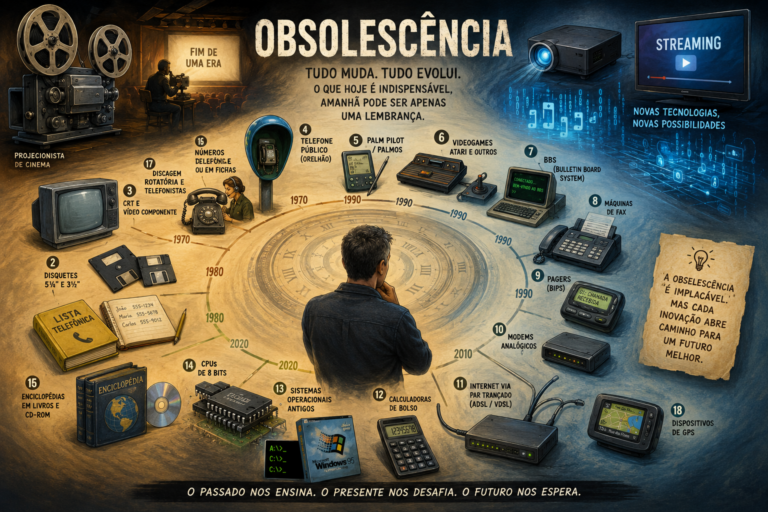

O mito que ele aponta é que a chegada de um software que alcance a inteligência humana, não apenas em “narrow tasks”, mas de forma abrangente, ou seja, uma superinteligência, que pelo hype atual parece ser inevitável e apenas questão de tempo, é uma falácia. Não seguir a linha dos tecno-otimistas e ter uma visão de ceticismo científico (termo popularizado por Carl Sagan) não é ser obsoleto e ter uma visão limitada do futuro da tecnologia. Creio que seja saudável ter pontos de vista que não sigam cegamente o hype, mas apresentem contrapontos, que podem levar à discussão e aprimoramento das próprias tecnologias.

Os atuais sistemas de IA estão limitados ao que conhecemos atualmente sobre a natureza da inteligência e todas as evidências apontam que as inteligências humanas e das máquinas são radicalmente diferentes.

O mito está em afirmar que essas diferenças são apenas temporárias e que se colocarmos maior poder computacional elas desaparecerão. Evoluir versões “narrow AI” adicionando mais dados e poder computacional não avançarão no rumo de uma IA inteligente. Precisamos de outras técnicas, que ainda não sabemos quais. Não existem hoje, com nosso conhecimento de IA, algoritmos para “inteligência geral” e ainda não sabemos como criá-los.

Um questionamento que faço é que se focarmos toda atenção, energia e investimentos nas atuais técnicas chamadas de GenAI, em uma corrida direcionada para aspectos financeiros (valuation das empresas) estamos perdendo oportunidades de explorar novas e criativas inovações. Uma cultura de inovação não pode ser limitada à hypenização das atuais técnicas, que já se mostraram que não são o caminho para essa tal “inteligência geral”.

Ninguém pode afirmar que um dia essa AGI eventualmente não surgirá, mas precisamos aplicar o ceticismo científico para não cair na armadilha de sermos conduzidos pelo hype, sem questionamentos (efeito FOMO) e tomar decisões, sejam de negócios ou regulatórias erradas.

O artigo sumariza o livro apontando que para o tipo de inferência necessária para uma hipotética AGI (abdução), não temos, hoje, a mínima ideia de como construí-la. E LLM não é o caminho. São gigantescos e sofisticados sistemas de indução. [Webinsider]

. . .